En intégrant la technologie d’authentification des images CAI directement dans le M11 et le Z9, Leica et Nikon font le premier pas « hardware » de lutte contre les fausses nouvelles. Mais il faut que cette technologie ne se limite pas aux appareils professionnels.

La déferlante d’images (fixe et animées) a un revers dont nous faisons tous les frais : la désinformation. La retouche et le trucage des images existent depuis les débuts de l’ère argentique et il n’a pas fallu attendre la guerre en Ukraine ou les cortèges antivaccins pour voire circuler des faux. Mais les plateformes – et l’ère ! – numérique accentuent leur impact. Et en tant que « responsable » de la plupart des retouches avec son logiciel phare Photoshop, l’éditeur américain de logiciels de création a une responsabilité particulière qu’il commence à prendre avec sa Content Authenticity Initiative. Une plateforme qui profite aujourd’hui de ses premières briques matérielles dans des boîtiers photo signés Leica et Nikon.

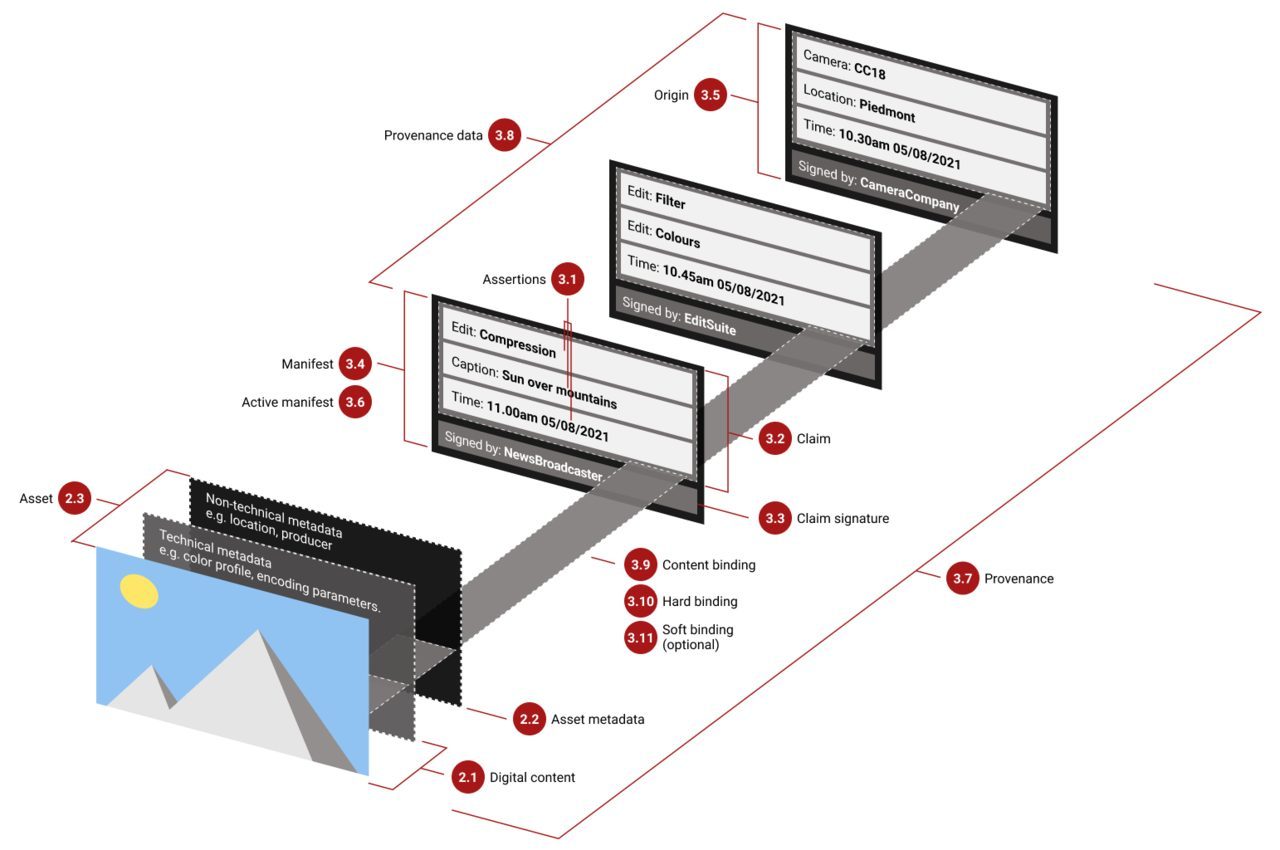

La Content Authenticity Initiative (ou CAI) est un projet qui ne tombe pas du ciel. C’est en 2019, avec le soutien du New York Times et de Twitter, qu’Adobe annonce la création du projet. S’appuyant sur un système couplant métadonnées et système de signatures numériques certifiées, la CAI est une chaîne complète de vérification de l’image. Ou plutôt, la CAI défini une chaîne complète, pour l’heure, il manque encore des composantes. Et parmi elles, celle du matériel était capitale.

Ce sont le japonais Nikon et l’allemand Leica qui sont les premiers fabricants à faire l’effort d’intégrer la CAI dans leur boîtier. « Leur » au singulier, car cela ne concerne pour l’heure qu’un seul appareil par marque : le M11 pour Leica, et le Z9 pour Nikon. Deux boîtiers qui n’ont pas été choisis au hasard, parce qu’ils ciblent tous les deux (à leur façon), un public de photojournalistes, de reporters de terrain. Maillons essentiels de la production de contenu d’information, ce sont eux qui, les premiers, ont besoin de montrer patte blanche et de prouver la véracité de leurs témoignages.

Déjà présente physiquement dans les smartphones de 2021

Trois ans après la constitution du projet, on peut se réjouir que la technologie arrive enfin dans le « dur », dans les appareils. Les cycles matériels n’ayant rien à voir avec ceux du logiciel, et considérant les barrières structurelles additionnelles qu’ont représenté la pandémie, les pénuries, et aujourd’hui les incertitudes géopolitiques, on peut considérer que ce fut même assez rapide dans le monde très conservateur de la photo.

Lire aussi : Snapdragon 888 : pourquoi son processeur d’image Spectra 580 est une révolution (Déc. 2020)

Un monde moins conservateur était prêt depuis la fin de l’année 2020 : celui des puces de smartphones. Ou plus précisément, la puce haut de gamme de Qualcomm de l’époque, le Snapdragon 888. Spécialiste du traitement d’image avec ses processeurs d’image Spectra et champion des SoC de smartphones, Qualcomm a intégré les prérequis matériels incroyablement tôt dans sa puce… mais laissant à la charge des intégrateurs (les constructeurs de smartphones) et de leurs partenaires logiciels le soin de s’emparer de la technologie. Ce qui, à notre connaissance, n’a pas encore était fait à l’heure actuelle.

Une technologie à démocratiser en masse

Sur le papier, il peut sembler logique que les reporters soient les premiers équipés d’un mécanisme permettant de vérifier leurs images. Mais la réalité des « fake news » et de leur diffusion font que dans les faits, c’est dans les mains des appareils destinés au grand public que ces technologies sont les plus importantes. Il a certes eu quelques histoires de photographies retouchées par quelques photojournalistes, la plupart du temps des stringers d’agences. Mais ce sont des cas isolés qui ont mené, très rapidement, à des prises de conscience et des actions technologiques. Ainsi, l’AFP dispose d’un logiciel qui vérifie automatiquement les modifications opérées aux images. Si un petit supplément d’exposition est toléré, la duplication ou l’effacement de contenu sont des interdictions absolues, et sont désormais automatiquement repérées.

A contrario, les contenus d’information capturés par le grand public, qu’ils s’agissent de civils ukrainiens, de partisans de Bachar el Assad ou de propagandistes du Kremlin, n’ont aucun garde-fou technique. Ce alors que ce sont ceux qui en auraient le plus besoin, vu le nombre de recyclages d’images, de retouches, de montages qui circulent sur les réseaux sociaux… qui alimente et font dorénavant réagir les rédactions du monde entier dans la minute.

Même constat du côté des appareils photo grand public. Si nous avons l’habitude de voir les reporters des pays « riches » équipés en boîtiers haut de gamme de Sony, Nikon, Canon, Leica ou Fujifilm, la réalité est que dans de nombreux pays, les pigistes, freelances, citoyens journalistes et autres « stringers » officiels sont souvent équipés en boîtiers d’entrée de gamme. Et dépourvus de ces technologies. Qu’il convient, pourtant, de démocratiser en masse.

Les briques manquantes d’un système (forcément) imparfait

On l’a vu, pour la CAI fonctionne un jour et représente un vrai bouclier de protection contre les fausses images, il faut déjà que son adoption non seulement s’accélère, mais surtout qu’elle s’étende à tous les appareils. De toutes les gammes, appareils photo comme smartphones. Ensuite, il convient d’en fait un standard reconnu par tous les logiciels d’édition d’image, afin que rien ne passe entre les mailles du filet. La solidité d’une chaîne de confiance est égale à la résistance de son maillon le plus faible.

En sus, il convient non seulement de communiquer à destination du grand public, mais aussi de lui donner des outils numériques pour valider une information. Telle une plateforme commune de vérification des images qui pourra vous dire, d’un simple glisser-déposer de votre PC/smartphone, si l’image que vous envoyez est bien l’originale. Espérons que les techniciens, ingénieurs et les quelques journalistes qui travaillent sur le sujet ont conscience de la nécessité de créer cet outil pour le public. Un public qui doute de plus en plus et à tendance à vouloir (et c’est positif !) à vérifier lui-même. Mais pour vérifier, il faut les bons outils.

Aussi bonne et blindée techniquement – la question de sa falsification se posera rapidement – la CAI sera un garant technique de l’intégrité de la photo. Mais il restera impossible de dire si les soldats que vous voyez sur telle image sont bel et bien des Ukrainiens soutenant M. Poutine ou des Russes déguisés avec de l’équipement capturé. Mais on saura au moins que l’image a été prise tel jour, à tel endroit et qu’elle n’a pas été altéré ou qu’elle a été éditée par tel logiciel qui a opéré telle et telle opération. Et dans le chaos de la course à la vérification de l’information, ce seront déjà des validations bienvenues pour commencer à restaurer la confiance. Et il est cocasse que le dispositif de protection soit porté par le premier responsable de ces manipulations !