Conçu autour de l’IA LaMDA, le projet Wordcraft de Google consiste en un traitement de texte qui aide les écrivains et rédacteurs à améliorer leur écrits. De la réécriture des phrases à l’ajout d’éléments comiques, cette béquille logicielle va-t-elle devenir incontournable ?

Après Dall-E, ou l’IA a prouvé qu’elle pouvait aider (supplanter ?) les hommes dans la création d’image, voici qu’elle s’invite dans nos textes. L’outil s’appelle Wordcraft et ce sont les ingénieurs de Google qui sont derrière. Eux, et une IA dont vous avez sans doute déjà entendu parler : LaMDA. Récemment au cœur d’un micro-scandale après qu’un ingénieur (remercié depuis) a décrété qu’elle avait une âme, LaMDA est à l’origine une IA conversationnelle. Entraînée pour parler avec les humains, dans Wordcraft ce super chatbot est utilisé pour souffler les bons mots – voire les bonnes phrases – aux écrivains. Et les aider à améliorer leurs histoires.

Lire aussi : LaMDA, la nouvelle technologie de Google pour converser naturellement avec un ordinateur (mai 2021)

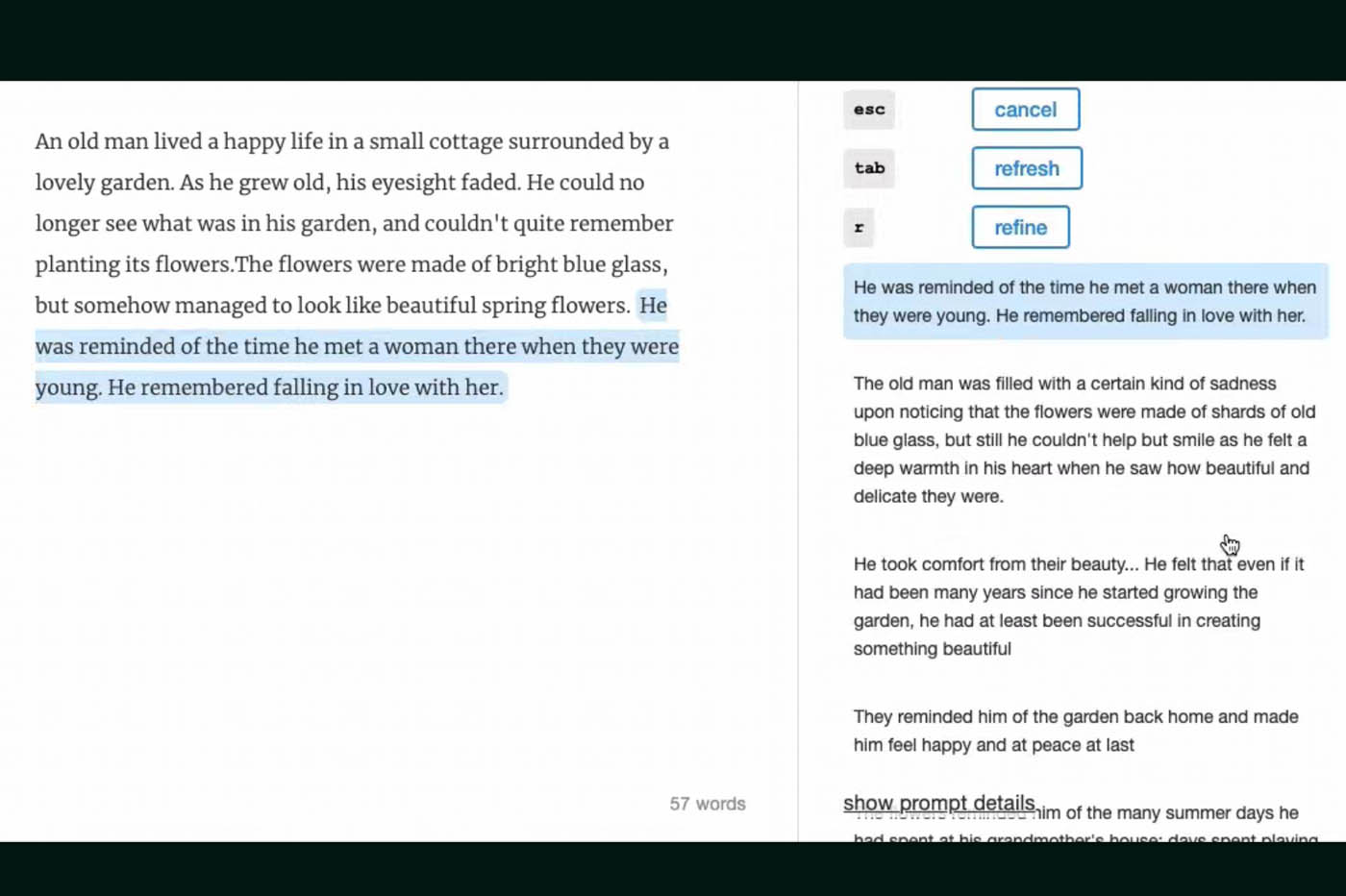

Pour éprouver ses forces et surtout ses limites, les ingénieurs de Google ont confronté une première version de l’outil Wordcraft à treize professionnels de l’écriture – et quelques membres de la presse. Dont un confrère de The Verge qui fait écho de son expérience lors du [email protected] Intégré dans un éditeur de texte web utilisable dans un navigateur, l’IA n’écrit pas à la place de l’auteur pendant sa frappe, mais doit être sollicité par des requêtes. Qui peuvent soit compléter votre histoire, soit lancer des idées de manière plus ou moins… chaotique.

Notre confrère de The Verge a ainsi tapé « manchots nageant » et Wordcraft (et LaMDA derrière) lui ont suggéré différentes idées d’histoires… Plus ou moins réalistes (voire dingues), mais au moins de quoi se lancer. Cela étant, l’outil ne peut être utilisé pour générer une vraie histoire : tous les auteurs qui ont participé au test ont unanimement affirmé que Wordcraft est incapable de remplacer un auteur. Notamment parce que l’outil n’arrive pas à rester dans le réel, ni n’arrive à conserver un style narratif constant ou se sortir des phrases clichées. Non plus qu’il ne peut décrire des mauvais personnages. Ça, on sait pourquoi : à chaque fois que des entreprises comme Google ont laissé leurs IA en roue libre, elles sont toutes devenues racistes et conspirationnistes !

Lire aussi : Microsoft censure son nouveau chatbot pour éviter qu’il ne devienne raciste

Aucune de ces limites n’était une surprise pour les équipes de Google. Lors de l’événement de présentation de la technologie, le chercheur Douglas Eck de l’équipe de Google Research résume avec beaucoup de lucidité : « Une des découvertes clés, est qu’on ne peut pas utiliser LaMDA pour écrire une histoire complète. C’est un outil bien plus intéressant quand il est utilisé pour ‘’épicer’’ (un récit, ndr) ». Notre confrère l’a démontré dans sa tentative de texte. Une histoire dans laquelle un phoque capture les œufs d’une maman manchote, qui ensuite se rue à la mer pour récupérer… ses bébés. Qui ne sont cependant pas nés, puisque ce sont des œufs qui ont été volés.

Comme à chaque étape de la création d’outils basés sur les IA, les scientifiques et chercheurs éprouvent les limites à dépasser. Ici l’outil semble déjà avoir des usages potentiels pour générer des idées et vous sortir du blocage. Mais hors de question pour l’heure de le laisser raconter des histoires à notre place. Ouf.

Source :

The Verge