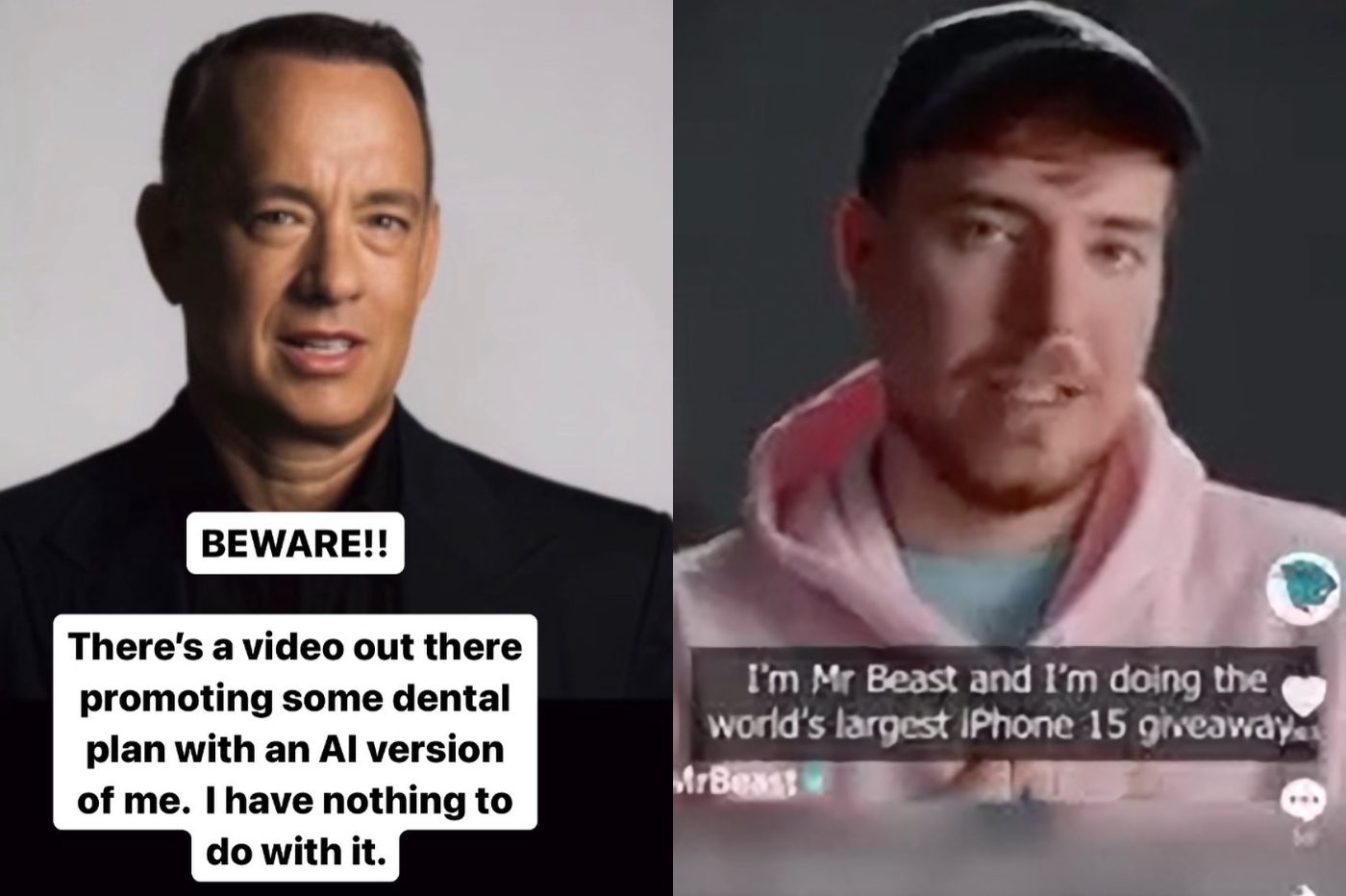

C’est la face sombre de la révolution de l’intelligence artificielle : il n’a jamais été aussi facile d’usurper l’identité d’autres personnes, aussi bien leur image que leur voix. Coup sur coup, deux exemples impliquant des vedettes rappellent les dangers des deepfakes toujours plus réalistes.

Non, Tom Hanks ne vend pas d’assurance dentaire sur les réseaux sociaux. L’acteur — le vrai — a prévenu sur son compte Instagram que la vidéo où on le voit faire la pub d’une couverture pour les soins dentaires est un fake. « Je n’ai rien à voir avec ça », explique-t-il.

La réclame affiche une version virtuelle de Tom Hanks, avec sa voix reproduite par IA. En mai dernier, le comédien déplorait dans un podcast que ces technologies pourraient le reproduire « à l’âge de 32 ans jusqu’à la fin des temps » : « N’importe qui peut maintenant se recréer à n’importe quel âge, avec l’IA ou les deepfakes (…) À part le fait de savoir que ça a été fait avec l’IA, rien ne vous indiquera qu’il ne s’agit pas de moi ».

L’IA et son usage par les studios sont d’ailleurs au cœur de la grève des acteurs à Hollywood. Le fait est que les deepfakes en particulier sont de plus en plus difficiles à repérer à l’œil nu et qu’il faut avoir une bonne expérience de ces images pour déterminer avec certitude que telle vidéo a été bidonnée.

Autre médium, autre public, mais même problème : le fameux youtubeur Jimmy Donaldson, mieux connu sous le sobriquet de MrBeast, a alerté ses fans qu’une vidéo deepfake circulait sur TikTok où on peut voir un clone très convaincant annoncer un concours pour gagner des iPhone ; il faut « simplement » donner 2 $ pour participer. MrBeast est coutumier des concours, mais il s’agit là d’une arnaque pour siphonner des données, voire des informations bancaires.

Lots of people are getting this deepfake scam ad of me… are social media platforms ready to handle the rise of AI deepfakes? This is a serious problem pic.twitter.com/llkhxswQSw

— MrBeast (@MrBeast) October 3, 2023

TikTok a beau interdire les deepfakes, les escrocs trouvent toujours le moyen de contourner les sécurités. Le youtubeur se demande comment les plateformes de réseaux sociaux vont gérer ce type d’arnaques de plus en plus réalistes. La question mérite effectivement d’être posée.

Décision cruciale de Facebook

Facebook pourrait apporter un début de réponse. Le comité de surveillance du réseau social va dans les prochains jours communiquer sur le retrait d’une vidéo « modifiée » de Joe Biden qui circule sur Facebook. Ce dossier « examinera des questions liées à la manipulation des contenus sur les plateformes de Meta et aux politiques de transparence de l’entreprise en matière de désinformation, notamment en période électorale ».

Le comité ne donne pas de détail sur la vidéo en question, mais les décisions qui seront prises pourraient bien faire jurisprudence sur Facebook, et surtout donner une marche à suivre claire. La politique de l’entreprise est en effet assez nébuleuse au sujet des vidéos trafiquées : les deepfakes sont normalement interdits… sauf quand ils ne le sont pas ! Une clarification est d’autant plus cruciale que la campagne électorale de la prochaine élection américaine risque d’être noyée sous les fausses vidéos générées par l’IA.

Lire Quand l’IA permet de multiplier les deepfakes politiques