Dans le monde parallèle des images conçues par des algorithmes, l’après-guerre a été riche en événements méconnus. En 1962, la chimiste britannique Rosalind Franklin aurait obtenu le prix Nobel de médecine pour sa découverte de l’ADN. En 1957 se serait tenue la première convention furry – un mouvement d’adeptes de déguisements animaliers. Sept ans plus tôt, des scientifiques auraient même découvert au pôle Sud des structures signées d’une civilisation inconnue.

Ces événements n’ont jamais eu lieu, et pourtant, en apparence du moins, des « photos d’époque » les documentent. Malgré leur patine qui semble d’époque, ces clichés ont été générés en 2023 à l’aide d’intelligences artificielles (IA) génératrices d’images. En vérité, aucune mégastructure n’a jamais été découverte sous l’Antarctique ; le mouvement furry n’est pas apparu avant les années 1980 ; quant à Rosalind Franklin, elle est morte en 1958 et n’a jamais reçu le prix Nobel.

Depuis le lancement de la cinquième version de Midjourney, en mars 2023, qui a marqué la démocratisation de l’IA génératrice d’images, il n’a jamais semblé aussi simple de falsifier l’histoire à l’aide d’illustrations factices. D’innombrables créations de ce genre ont été mises en ligne sur Reddit, Twitter ou Facebook. Si certaines sont à l’évidence humoristiques, d’autres instillent le doute quant à leur authenticité.

De la plaisanterie potache à l’archive ambiguë

Toutes les photos artificielles ne sont pas crédibles. On a ainsi vu apparaître, à la fin d’avril, de pseudo-photos de l’armée d’argile, une collection de huit mille soldats chinois en terre cuite datant du IIIe siècle avant J.-C., accompagnée d’un très anachronique bus en terre cuite : l’humour potache de la scène laissait peu de doute sur la nature factice de l’image.

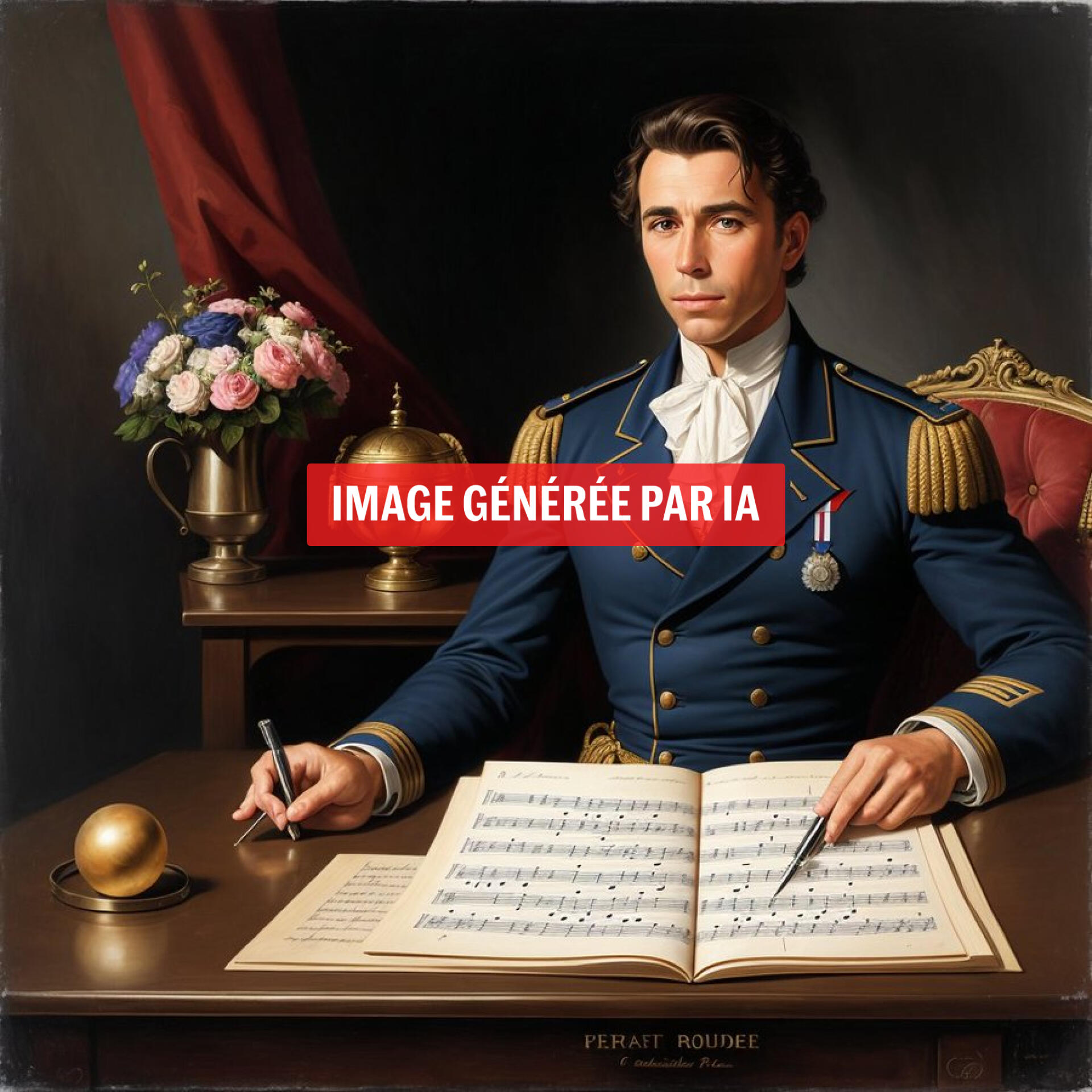

Mais d’autres jouent davantage sur la frontière entre le plausible et le faux. Ainsi d’une représentation façon huile sur toile de l’insurrection royaliste de 1795 ou d’un portrait de Rouget de Lisle en pleine composition de La Marseillaise qui peuvent semer le doute chez observateur, qui n’a pas l’œil et la connaissance aiguisés de l’historien.

« Il y a plein de détails anachroniques ou suspects », comme le mobilier, remarque Pascal Dupuy, maître de conférences à l’université de Rouen et spécialiste des images sur la Révolution française. « Si on donne [à l’IA] des sources sur la Révolution française, on risque de la nourrir de tableaux du XIXe siècle, qui comportent déjà eux-mêmes leur lot d’anachronismes », notamment avec les uniformes.

Autre exemple d’incongruité qu’un œil expert saura relever, Claude Joseph Rouget de Lisle y porte la légion d’honneur, alors qu’il ne l’a reçue qu’à la fin de sa vie, sous la monarchie de Juillet, bien après la composition de son célèbre hymne. L’IA n’a certes pas le monopole de l’anachronisme : les toiles du XIXe siècle qui lui servent de référence en sont déjà remplies. Mais Midjourney en génère par milliers.

Dernier risque, celui que l’IA efface les désaccords entre historiens ou caricature certains personnages historiques complexes. Ainsi de Maximilien Robespierre, que les quelques reconstitutions algorithmiques montrent souvent le visage fermé, menaçant, comme le tyran qu’il est devenu dans une partie de la littérature. Une représentation à contre-courant de son portrait d’époque exposé au Musée Carnavalet, « où il esquisse un sourire, le visage largement ouvert », relève M. Dupuy. En ce sens, ces images peuvent subrepticement orienter notre imaginaire et fausser notre rapport à l’histoire.

Piégés par de pseudo-archives photographiques

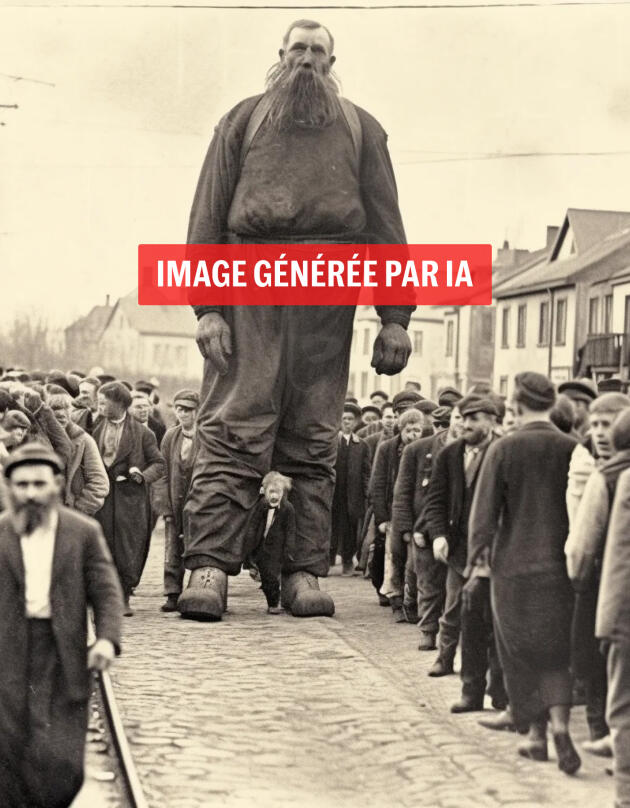

Leur effet est particulièrement prononcé quant ils prennent la forme de photographies. Depuis la fin d’avril, une des tendances chez les utilisateurs de Midjourney consiste justement à mettre en scène des curiosités zoologiques avec le style et le grain de clichés des années 1890 à 1920.

Sur le forum Reddit, un utilisateur de Midjourney pressent le danger : « Il y a de quoi faire une chaîne YouTube entière racontant ces faux événements en utilisant ces photos. Et même deux, la seconde expliquant en quoi les événements de la première sont bidons. »

Ces facéties aux allures de Guinness des records ont vite attiré l’attention d’internautes en mal d’audience et peu scrupuleux. Comme un compte Twitter baptisé Interesting Channel, qui a glané plus de cent mille visites – le double de son nombre d’abonnés – en présentant une fausse photographie d’équidé géant comme celle, supposément authentique, du « plus grand cheval de l’histoire ».

La pseudo-photo du « dernier des géants du Néandertal » a fait le tour du monde, sans avertissement sur son caractère factice. « Tandis que la plupart des gens ont clairement relevé que ces images ne pouvaient pas être vraies, une minorité [de personnes] y a cru », déplore le Finlandais Janne Ahlberg, qui gère sur Twitter un compte de veille sur les fausses images, HoaxEye.

Une aubaine pour le discours complotiste

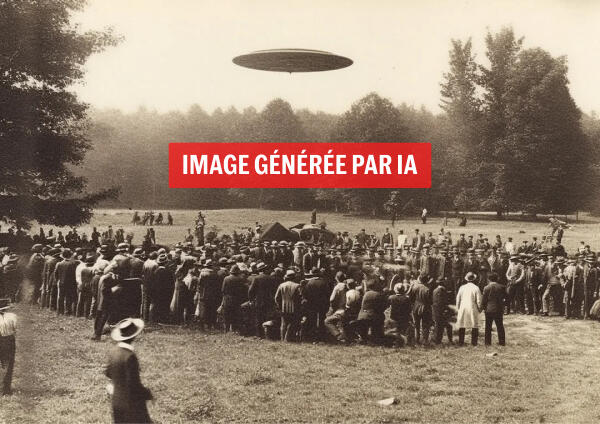

Ce type de production menace d’alimenter les croyances conspirationnistes. Un internaute a ainsi généré une série de fausses archives montrant, de manière humoristique, derrière un impeccable jaune sépia, le « premier contact [avec des extraterrestres] en 1863 ». Une aubaine pour les « chercheurs de vérité » en manque de preuves visuelles, et souvent peu regardant sur leur provenance.

A la fin d’avril, une photographie factice montrant Stanley Kubrick en plein tournage de la mission Apollo 11 – une rumeur classique dans la complosphère, mise ici en image sous Midjourney – a ainsi été vue plus de 1,5 million de fois sur Twitter, et prise au premier degré. « Les mêmes personnes se font déjà probablement avoir avec des photos “photoshopées” ou des images de synthèse, nuance M. Ahlberg. Mais à l’évidence, l’IA permet de générer bien plus d’images, plus vite, donc il y aura naturellement de plus en plus de contenus trompeurs en ligne. »

Le phénomène ne remplacera pas forcément les bonnes vieilles images détournées. Au même moment, l’ufologue complotiste Silvano Trotta partageait un cliché authentique de l’ultime mission sur la Lune, en 1972, mais, par méconnaissance de la physique lunaire, il interprétait le peu de traces d’un rover de l’espace pour accuser la NASA de mise en scène. Vraies et fausses images se rejoignent ainsi, dans un concert général croissant de confusion et de désinformation.

Quand l’extrême droite met en image l’histoire

L’étape prochaine consiste à voir des personnalités publiques s’emparer de cette technologie à des fins politiques. Aux Etats-Unis, Eric Trump (le second fils de Donald Trump) a partagé au début d’avril une photographie algorithmique virale, non datée, d’un défilé à la gloire de son père dans les rues de New York.

Le Monde

Offre spéciale

Accédez à tous nos contenus en illimité à partir de 10,99 5,49 €/mois pendant 1 an.

En profiter

En France, le militant d’extrême droite Damien Rieu, candidat Reconquête ! aux dernières élections législatives, a illustré un fil Twitter, le 2 mai, sur la traite des Noirs par les arabo-musulmans avec un tableau artificiel d’un homme en turban, glissé parmi des archives authentiques. « Les négriers arabes attiraient les enfants avec des dattes », légende le politicien. « J’ai utilisé Midjourney car je n’ai pas trouvé d’illustrations ou de tableau avec cette mise en scène du témoignage », explique Damien Rieu auprès du Monde. Il avait d’ailleurs prévenu ses abonnés qu’il recourait parfois à l’IA.

Problème : l’image qu’il partage n’est ni fidèle ni neutre. « Elle rejoue les poncifs de l’Arabe esclavagiste avec tous ses attributs permettant de l’identifier : turban, barbe, etc., qui gomment la pluralité des acteurs de la traite et de l’esclavage indo-océanique », note Marie-Aude Fouéré, maîtresse de conférences à l’EHESS et membre de l’Institut des mondes africains, autrice en 2020 d’une étude sur la représentation du marché aux esclaves à Zanzibar.

Dans les commentaires, aucun des abonnés du communicant d’extrême droite – qui avait été poursuivi en 2015 par SOS-Racisme pour « provocation à la haine raciale », avant d’être relaxé – n’a relevé que l’image était une chimère algorithmique, ni ne s’est étonné du procédé.