Toute la journée, les serveurs de la communauté Discord consacrée à l’outil de génération d’images Midjourney voient affluer des milliers de messages de requête. Sur ce serveur qui compte plus de deux millions et demi de membres, il suffit de taper une description textuelle pour qu’un bot renvoie une série de quatre images. On y trouve des tableaux abstraits censés dépeindre le dernier être humain sur Terre, des requêtes très spécifiques (comme « des chats en train de tirer des lasers dans l’espace, réaliste, 4K, cinématographique ») ou au contraire très vagues (comme « blockchain » ou « inventer la réalité »). Quelle que soit la requête envoyée par l’utilisateur, pour peu qu’elle ne contrevienne pas au règlement qui interdit notamment de produire du contenu « visuellement choquant », des images seront générées avec des résultats plus ou moins satisfaisants.

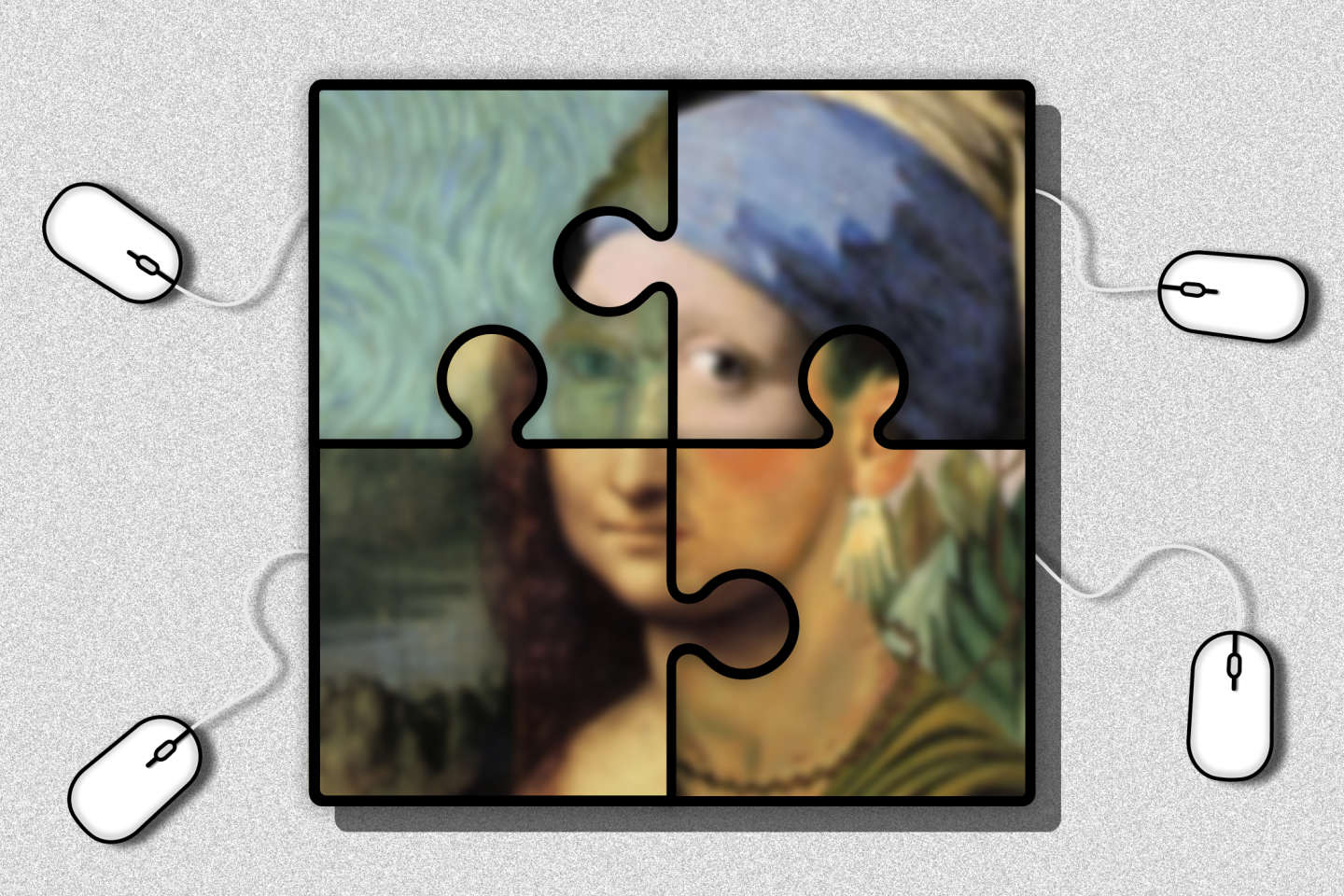

Depuis le mois de juin, les logiciels capables de produire des images à partir d’une ligne de texte – en se fondant sur une base de données qui peut comprendre des centaines de millions d’images provenant d’Internet – ont explosé en popularité sur les réseaux sociaux, en grande partie grâce aux visuels tantôt poétiques, tantôt surprenants qu’ils génèrent. S’il est plutôt facile de produire une image en utilisant des programmes comme Midjourney, il faut un certain temps pour déterminer quel type de tournure de phrase employer pour obtenir un bon rendu, ou du moins fidèle à ce qu’en attend l’utilisateur – un processus qu’on appelle le prompt crafting (« fabrication rapide »).

L’art de la requête

Dans le souci d’améliorer les images qu’ils produisent, des utilisateurs s’échangent donc fréquemment des conseils afin d’affiner leurs descriptions textuelles ou de contourner les points faibles des intelligences artificielles utilisées. « Il semblerait qu’il y ait un bug sur la couleur des yeux des rousses. Nous sommes en train de faire des essais, mais c’est impossible de leur donner autre chose que des yeux bleus ou verts pour le moment », se lamente une utilisatrice de Midjourney, tandis qu’un autre implore les autres membres de l’aider à trouver les bons mots-clefs pour générer un lion anatomiquement correct. Sur un fil Reddit consacré à l’outil Stable Diffusion, les mêmes questionnements sont égrenés : « Qui sait comment produire des êtres humains cohérents au lieu de ces monstruosités abstraites ? » ou « Quelqu’un aurait une bonne description pour générer un gobelin ? », pour ne citer qu’eux.

Certains utilisateurs ont mis au point des guides gratuits pour aider les membres de la communauté à se familiariser avec ces différents programmes. Dans un livre numérique qui traite de DALL-E 2, un autre logiciel, on trouve notamment des adjectifs facilement compris par l’outil, ainsi que des exemples de descriptions pour générer des images réalistes, des peintures ou encore des diagrammes scientifiques. « Tous les jours, je voyais des découvertes intéressantes sur Twitter, Reddit et Discord, et j’ai eu envie de les rassembler au même endroit », explique Guy Parsons, auteur de l’ouvrage.

Il vous reste 59.76% de cet article à lire. La suite est réservée aux abonnés.